Frontend Design Skill 怎么选:前端设计类 AI 技能的评估与安装前检查

2026/5/8

面向在 ClawSkills 查找 frontend design skill 的用户,本文说明如何评估前端设计类 AI 技能的适用场景、前置条件、安装配置要点、低风险验证方法和工程交接注意事项,帮助减少试错成本。

Frontend Design Skill 怎么选:前端设计类 AI 技能的评估与安装前检查

在 ClawSkills 搜索 frontend design skill,通常是因为你面临一个具体任务:需要 AI 帮你草拟页面结构、给出组件建议、提取现有项目的设计规范,或者在交付前做一轮响应式和无障碍检查。

这类任务的共同特征是:结果需要人工介入才能落地,AI 技能提供的是候选方案,而不是可直接上线的生产输出。在这个前提下,选择哪个技能的关键不是"哪个最好",而是:这个技能的适用场景和前置条件,是否和我当前的任务匹配?

本文从技能详情页审查、安装前检查、低风险验证三个角度,梳理如何在 ClawSkills 上评估和使用前端设计类 AI 技能。

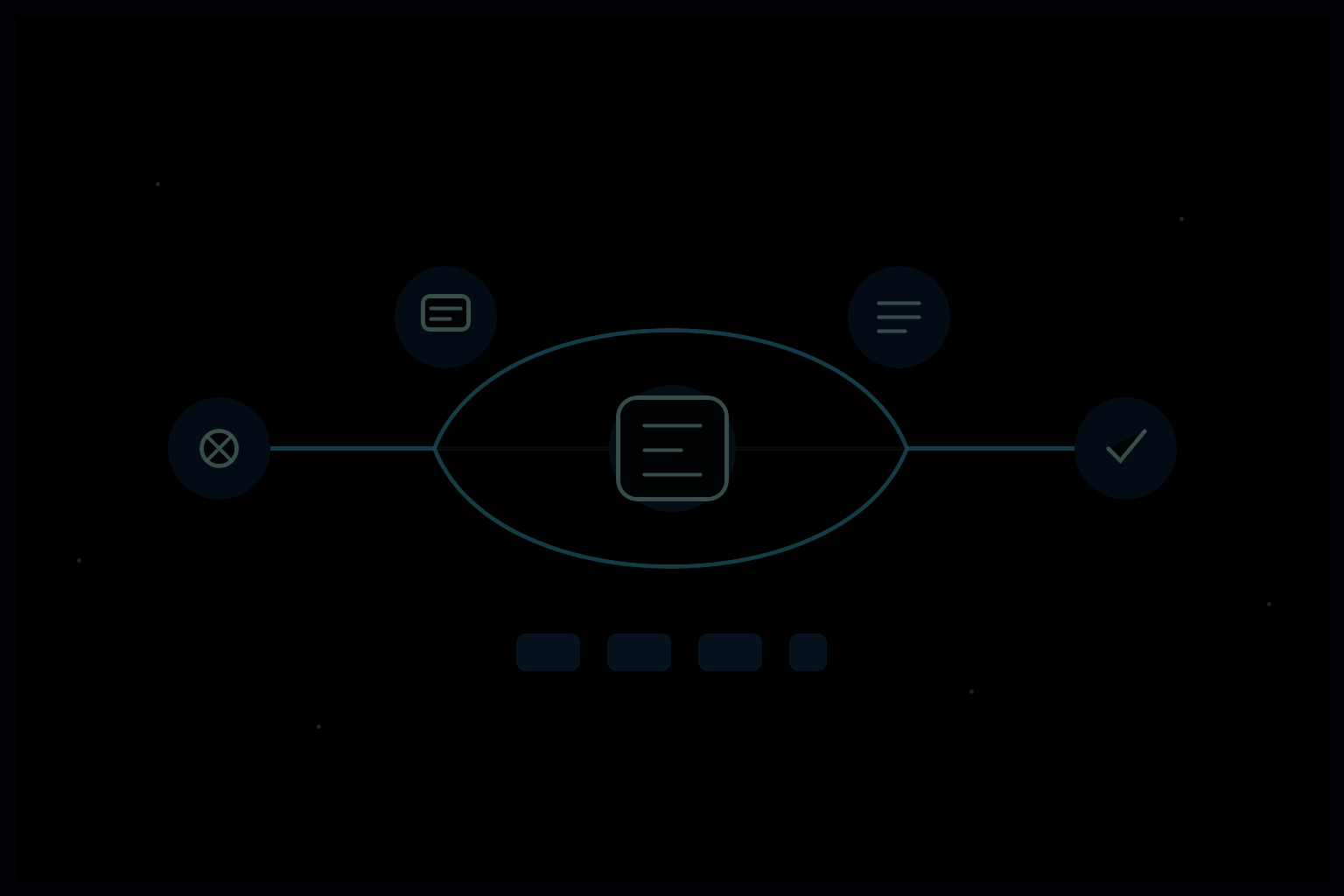

评估 Frontend Design Skill 的三层架构

前端设计类 AI 技能在技能详情页上的描述,可以从三个层次来拆解,帮助你判断是否符合当前需求:

第一层:输入层(你需要提供什么)

技能详情页通常会说明它接受哪种输入:文字需求描述、Figma 链接、现有代码库路径、截图,还是其他格式。在安装前,核查以下几点:

- 你能提供的输入格式,是否在该技能的支持范围内?

- 技能是否要求特定技术栈(如 React + Tailwind CSS)?你的项目是否匹配?

- 如果技能需要访问本地代码库,你的项目结构是否满足它的扫描条件?

输入层不匹配是安装后最常见的失望来源之一,在详情页确认清楚可以节省大量试错时间。

第二层:能力层(技能实际做什么)

前端设计类技能的能力声明通常包含以下几类,需要分别判断:

- 组件结构建议:给出组件拆分方案和 props 边界建议,输出是参考方案,需要工程师判断是否采纳

- 样式与设计令牌提取:从现有代码库中归纳颜色、间距等设计变量,输出需要人工核查准确性

- 响应式与无障碍检查:对照标准(如 WCAG)给出清单式检查结果,仍需结合真实设备验证

- 页面原型草稿:从文字需求生成代码草稿,适合作为起点而非最终稿

如果你在 ClawSkills 找到候选技能 终极前端设计技能,详情页核查时需要确认:它的能力层是否覆盖了你当前的任务类型,以及输出格式是否便于你的工程流程接入。安装前建议先用单个页面做小范围验证,再判断是否推广到整个项目。

第三层:输出层(你会得到什么,需要做什么才能用)

技能的输出通常不是"交付物",而是"半成品"。在评估阶段,需要明确:

- 输出是代码片段、文档草稿,还是结构化检查报告?

- 输出是否需要人工进行设计评审,才能判断是否符合产品语义?

- 工程交接时,输出物是否能进入团队的代码评审流程,还是需要额外转换?

明确输出层,能帮你提前规划"谁来做人工复核",避免在使用后才发现输出格式与团队流程不兼容。

ClawSkills 使用对齐:技能详情页不是质量背书

在 ClawSkills 上,技能详情页的作用是帮你评估和决策,而不是对输出质量做担保。几个使用对齐点:

- 详情页是发现和评估的起点:适用场景、前置条件、输入输出格式说明,是你在安装前应该重点阅读的内容。

- ClawSkills App 安装是有条件的:部分技能需要特定运行环境或配置步骤,详情页的安装说明需要逐项核查,而不是假设所有场景都适用同一安装路径。

- 先做最小验证,再扩大使用范围:选定候选技能后,用一个低风险的具体任务(如草拟单个页面的响应式结构)来验证输出质量,确认符合预期再推广。

- 生产环境输出必须经过人工复核:AI 技能的输出,特别是涉及组件边界决策和设计令牌定义的部分,需要有工程经验的人介入判断,不适合跳过评审直接上线。

实战案例:三类低风险 ClawSkills 使用工作流

场景一:新页面草稿

任务:为一个新功能页面生成初始的组件结构和样式草稿。

低风险工作流:

- 在 ClawSkills 找到候选前端设计技能,阅读详情页确认支持的技术栈和输入格式

- 用文字描述一个单页需求,生成组件结构草稿

- 工程师人工评审:组件拆分是否合理,状态设计是否覆盖加载态、空态、错误态

- 通过评审后,作为开发起点,而非直接提交代码评审

适用技能参考(需详情页核查后小范围验证):终极前端设计技能。

场景二:现有项目设计规范提取

任务:分析已有代码库,整理出当前项目的设计令牌和组件使用模式。

低风险工作流:

- 确认技能详情页明确支持你的项目技术栈(如 Next.js、Vite、Vue 等)

- 先指向局部模块或单个组件目录,验证提取结果的准确性

- 人工核查:颜色值、间距、组件命名是否与实际代码一致

- 确认准确后,再扩大扫描范围至整个代码库

适用技能参考(需详情页核查后小范围验证):前端设计提取器技能。

场景三:设计与工程交接辅助

任务:在设计稿到代码的交付阶段,用 AI 技能生成设计系统草稿文档,供工程师参考。

低风险工作流:

- 确认技能输出格式(Markdown 文档、代码注释、组件变体定义等)是否与团队流程兼容

- 用一个已完成的功能模块测试输出质量

- 设计师和工程师共同评审输出,补充技能无法判断的产品语义决策

- 将评审后的文档纳入代码库,而非直接以 AI 输出作为权威文档

适用技能参考(需详情页核查后小范围验证):Tailwind Design System 技能。

技能评估对比表

| 检查项 | 详情页应核查什么 | 低风险动作 | 不应假设 |

|---|---|---|---|

| 适用技术栈 | 技能是否明确列出支持的框架和工具链 | 用项目实际技术栈做一个小范围测试任务 | 不注明技术栈就意味着通用支持 |

| 输入格式 | 接受文字、代码路径、Figma 链接,还是截图 | 先用你能提供的输入格式测试一次 | 所有输入格式都被支持 |

| 输出格式 | 输出是代码片段、Markdown 文档,还是结构化报告 | 确认输出格式能进入团队的代码评审或文档流程 | 输出可以跳过评审直接使用 |

| 状态覆盖 | 技能是否说明会处理加载态、错误态、空态 | 在测试任务中检查输出是否包含边界状态 | 生成的代码自动覆盖所有状态 |

| 无障碍支持 | 技能是否说明遵循 WCAG 标准或输出语义 HTML | 人工检查输出的颜色对比度和键盘导航路径 | 声明支持无障碍就等于通过 WCAG 审查 |

| 安装配置 | 是否有明确的环境要求或配置步骤 | 按详情页安装说明逐步操作,不跳过配置项 | 安装后无需配置即可使用 |

技能安装后最小验证清单

安装任何前端设计类技能后,在扩大使用范围前,建议完成以下最小验证:

- ☐ 用一个真实的单页任务测试过技能,输出格式符合预期

- ☐ 输出的组件结构已经过工程师人工评审

- ☐ 颜色值和间距等设计令牌已核查是否与项目实际保持一致

- ☐ 确认技能输出不包含你不了解的第三方依赖

- ☐ 边界状态(加载态、空态、错误态)的覆盖情况已人工检查

- ☐ 在真实设备(iOS Safari、Android Chrome)上目视验证过至少一个页面

- ☐ 输出已进入团队的代码评审流程,而不是直接合并

常见问题

- 前端设计类 AI 技能能生成可直接上线的页面吗?

- 不建议这样假设。这类技能的输出通常是可用于讨论和开发起点的草稿,组件边界决策、状态覆盖完整性、无障碍合规性,都需要有工程经验的人介入判断。将 AI 输出视为"待评审的候选方案"是更稳妥的使用方式。

- 安装前应该重点核查详情页的哪些内容?

- 优先检查:支持的技术栈、接受的输入格式、输出格式、是否有明确的环境要求或配置步骤。其次确认:技能描述的能力是否覆盖你当前的具体任务类型,而不只是大方向匹配。

- 如何判断一个前端设计技能是否适合我的项目?

- 最直接的方法是用项目中一个低风险的任务(如单个页面或组件)做小范围验证,对比输出与你的工程预期,再决定是否推广使用。详情页说明只是筛选的起点,实际验证才是判断适用性的依据。

- 已有代码库的项目,能用 AI 技能提取设计规范吗?

- 有部分技能支持分析现有代码库并归纳设计令牌和组件模式,但提取结果需要人工核查准确性,尤其是隐式的设计决策(如特定颜色值的语义含义)。建议先对局部模块测试,确认提取准确度后再扩大范围。

总结

在 ClawSkills 查找 frontend design skill,本质上是在为具体任务寻找合适的辅助工具,而不是寻找能替代工程判断的自动化方案。

评估的核心路径是:详情页核查输入输出格式和前置条件 → 小范围验证候选技能 → 人工复核输出 → 确认后再扩大使用范围。跳过任何一步都会增加试错成本。

ClawSkills 技能库中,与前端设计工程化相关的候选技能可以通过关键词和场景描述进行查找,每个技能的详情页是你做评估决策的主要依据。