在 ClawSkills 配置爬虫 Skill:中文网页抓取与访问限制验证指南(2026)

2026/5/2

ClawSkills 如何降低爬虫类 AI 技能的发现、评估与配置成本?本文覆盖合规前置确认、中文网站抓取三层配置要点、各 skill 详情页可核查字段对比,以及 Cloudflare、CAPTCHA、访问限制等场景的合规评估与低风险验证思路。

在 ClawSkills 配置爬虫 Skill:中文网页抓取与访问限制验证指南(2026)

本文面向使用 Claude Code(OpenClaw)的用户——需要通过 AI 技能自动抓取中文网页内容,并希望了解如何在 ClawSkills 选择合适的爬虫 skill、完成配置,以及在遇到访问限制时有可操作的合规处理路径。

重要说明:ClawSkills 的核心价值在于降低 AI 技能的发现、评估、安装与配置成本,而非保证爬取任务的执行结果。实际抓取效果取决于目标站点的规则与访问策略、所选 skill 在详情页中声明的能力范围,以及用户本地运行环境的兼容性——三者缺一不可。

引言:爬虫 Skill 的选型成本在哪里

在 ClawSkills 上,浏览器自动化与网页抓取类 skill 已有多个选项,但这类技能的配置成本不像其他 skill 那么直观——它不是"安装→使用"两步就完成的,而是涉及合规前置确认、目标站点的访问策略、中文编码处理、请求头配置等多个层次。

本文目标:帮助你在技能详情页信息的基础上,理解爬虫类 skill 的配置层次,并根据目标场景(轻量抓取 vs 授权多页批量验证 vs 有访问限制的站点)选择合适的技能,降低反复试错的成本。

使用前置确认:在选择任何技能之前,应先确认目标站点的授权状态——查阅其 robots.txt、使用协议,并优先评估是否提供官方 API、RSS 订阅或数据导出功能。在获得明确授权的前提下,再进入技能选型与低风险验证流程。如果目标站点出现 Cloudflare 验证页或 CAPTCHA,可评估 隐身浏览器 stealth-browser 详情页中的适用条件声明;普通中文站点在授权明确后,可从 浏览器使用 browser-use 开始,完成单 URL 低风险验证后再决定是否继续。

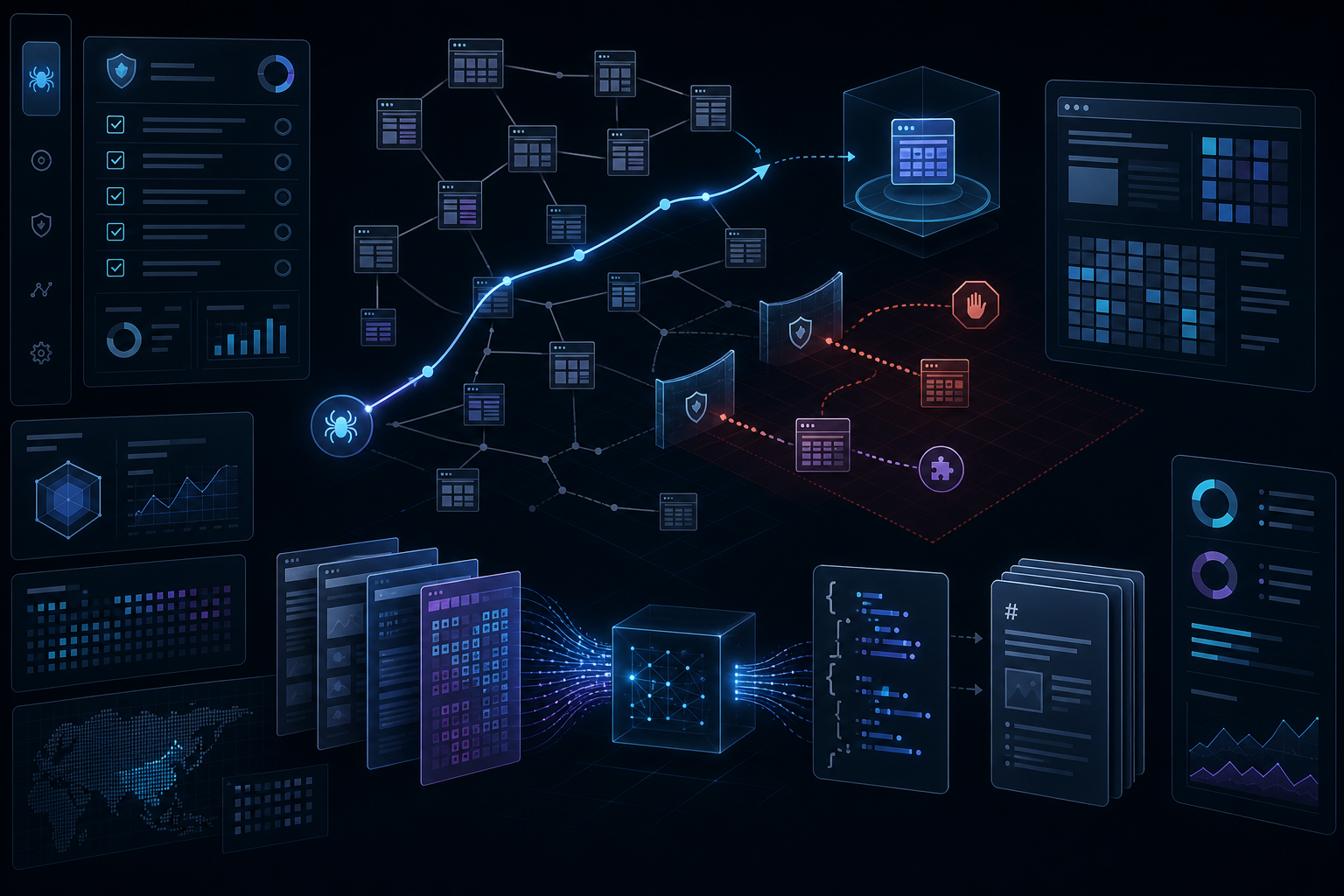

深度架构分析:爬虫 Skill 的三个配置层次

无论选择哪个 skill,爬取任务在执行时都会经过三个层次。理解这三层有助于在配置出问题时快速定位原因。

第一层:网络请求层

这一层负责发出 HTTP 请求或建立浏览器会话。关键配置变量:

- User-Agent 配置:部分中文站点会根据请求头中的 User-Agent 字段判断访问来源。支持自定义请求头的 skill 可在此层配置合规的访问标识(应符合目标站点授权范围内的访问要求)。

- Cookie/Session 管理:需要登录态的站点必须在此层维护持久会话,否则每次请求都会被当作游客处理。

- 请求频率控制:高频请求会触发速率限制(Rate Limiting),中文新闻和电商站点尤为常见。应严格遵守站点的速率限制规则。

第二层:渲染层

纯 HTTP 请求只能获取服务端渲染的 HTML。现代中文网站(微博、知乎、B 站、各类新闻聚合站)大量依赖 JavaScript 动态渲染,需要具备真实浏览器内核的 skill 执行 JS 后再提取内容。如果用不支持渲染的工具抓取这类页面,返回的会是空壳 HTML 或 JavaScript 占位符。

第三层:访问稳定性验证层

部分站点部署了访问控制与验证机制:

- Cloudflare Bot Management(对自动化访问的检测与拦截)

- 浏览器指纹检测(Canvas、WebGL、音频指纹等)

- 行为分析(访问频率、交互模式等)

- CAPTCHA(图形验证、滑块、点选文字等)

这一层的处理需要在详情页声明中确认相关能力,并在授权前提下通过低风险验证评估实际可用性。重要说明:任何访问稳定性技术的有效性都受目标站点策略更新影响,没有技能可以承诺对所有站点永久有效,实际效果必须通过低风险验证确认。遇到 CAPTCHA 时,不应尝试自动化处理——应改用人工验证、目标站点官方 API,或在自动化访问受到明确限制时停止。

爬虫 Skill 详情页可核查字段对比

以下对比基于各 skill 在 ClawSkills 技能详情页的公开说明,列出可在详情页直接核查的字段,供选型参考。主观评级已替换为可验证的详情页信息维度:

| Skill | 浏览器渲染 | 详情页提及反检测 | 详情页提及 Cookie/Session | 详情页提及 Cloudflare/CAPTCHA | 适合场景 | 主要前置条件 |

|---|---|---|---|---|---|---|

| 浏览器使用 browser-use |

真实浏览器 | 请在详情页确认 | 请在详情页确认 | 请在详情页确认 | 通用网页抓取、表单填写、截图、数据提取 | browser-use CLI 已安装 |

| 浏览器自动化 browser-automation |

真实浏览器 | 请在详情页确认 | 请在详情页确认 | 请在详情页确认 | 自然语言驱动的网页交互与数据提取 | CLI 命令行环境 |

| 极速浏览器使用 fast-browser-use |

真实浏览器 | 请在详情页确认 | 详情页提及 Cookie/LocalStorage 管理 | 请在详情页确认 | 授权多页批量验证、多标签页管理、精确 DOM 提取 | 支持高级状态管理的运行环境 |

| 隐身浏览器 stealth-browser |

真实浏览器(隐身模式) | 详情页有反检测相关说明 | 详情页提及持久会话管理 | 详情页有 Cloudflare/CAPTCHA 相关说明 | 有访问限制机制的站点(需先在详情页确认适用条件)、需要登录持久化的场景 | 首次登录需有界面模式;会话保存后可切换无头模式 |

注:各 skill 的实际能力以访问时 ClawSkills 技能详情页的当前描述为准;表中"请在详情页确认"意味着该字段需访问对应详情页自行核查,不代表能力缺失或具备。本文仅做选型维度整理,如有更新请以详情页为准。

哲学/世界观对齐:把 Skill 配置视为可验证的评估流程

ClawSkills 的核心设计逻辑是:将 AI 技能的发现、评估、安装与配置成本降到最低,让用户能快速判断某个 skill 是否适合自己的场景——而非替用户承担目标站点的访问授权或执行结果。

对于爬虫类技能,"配置"不只是安装后就结束——而是一个分层确认的过程。每一层的失败都提供明确反馈,而不是让用户面对一个模糊的"抓取失败"再盲目排查:

- 合规前置确认层:在选型前,先确认目标站点的 robots.txt 规则、使用协议,以及是否提供官方 API/RSS/数据导出。授权不明确时,应停止而非继续尝试。

- 技能详情页核查层:在安装前,在 ClawSkills 的技能详情页核查适用场景与前置条件,避免安装后发现环境不符。

- 安装方式确认层:确认详情页是否提供 ClawSkills App 安装入口;如未提供,按详情页说明进行手动配置,不预设一键安装可用。

- 配置说明核查层:按技能详情页的配置说明设置参数,不跳过前置依赖的验证步骤。

- 低风险验证层:用目标站点的单个公开 URL 先做小范围测试,确认基本功能可用后再扩大范围;验证失败时降级或停止,不盲目扩大请求量。

这种分层确认的做法避免了两个常见误区:一是在不了解前置条件的情况下直接配置导致的环境问题;二是在未经授权或有明确访问限制的站点上反复尝试、白白消耗时间。

中文站点抓取配置与访问限制验证

场景设定

目标:在授权前提下,抓取一个中文新闻聚合站点的文章标题与摘要列表。该站点部分页面需要 JavaScript 渲染,少数页面存在 Cloudflare 验证。本节所有步骤均以合规访问为前提。

步骤 1:合规前置确认与站点访问限制判断

在选择技能前,先完成以下合规核查:

- 访问目标站点的

robots.txt(通常为https://目标站点/robots.txt),确认是否禁止自动化访问或爬虫程序 - 阅读目标站点的使用协议或服务条款,确认是否明确限制自动化数据采集

- 评估目标站点是否提供官方 API、RSS 订阅或数据导出功能——有则优先使用

- 确认访问行为在授权范围内后,再手动访问目标站点,观察以下信号:

- 是否出现 Cloudflare 的"正在验证您的浏览器"中间页

- 是否有滑块或图文验证码

- 连续访问多个页面后是否出现 429 Too Many Requests

- 页面源码中是否存在大量 JS 渲染逻辑(查看源码时几乎没有实际内容)

如果 robots.txt 或使用协议禁止自动化访问,应停止并改用官方 API/RSS/导出。在授权明确后:若出现 Cloudflare 中间页,可在 隐身浏览器 stealth-browser 详情页确认适用条件;若页面需要 JS 渲染但无访问限制信号,从 浏览器使用 browser-use 开始单 URL 验证。

步骤 2:在技能详情页核查前置条件

以 stealth-browser 为例,在 ClawSkills 技能详情页确认:

- 当前系统是否满足运行环境要求(操作系统、依赖版本)

- 首次登录是否需要有界面模式(GUI 环境)保存会话

- 无头模式(headless)是否在当前环境可用

- 详情页是否提供 ClawSkills App 安装入口;如无,按详情页手动配置说明操作

步骤 3:配置核查清单

- ☐ 已确认目标站点 robots.txt 未禁止自动化访问

- ☐ 已阅读目标站点使用协议,确认操作在授权范围内

- ☐ 已评估目标站点是否提供官方 API/RSS/数据导出(如有,优先使用)

- ☐ 已阅读技能详情页的完整配置说明

- ☐ CLI 依赖已安装并可正常调用

- ☐ 目标 URL 可通过浏览器正常访问(排除网络问题)

- ☐ 已设置合理的请求间隔(建议先从 2—5 秒/请求开始,严格遵守站点速率限制)

- ☐ 已确认目标页面字符编码(UTF-8 为主;部分旧站点使用 GBK)

- ☐ 已确认提取目标的 CSS Selector 或 XPath 路径

- ☐ 如需登录,已通过有界面模式完成首次登录并保存会话

- ☐ 已确认输出格式需求:Markdown、JSON、CSV 或纯文本;如涉及简繁转换、全角/半角处理或中文日期格式(如二〇二六年五月二日),已在配置中声明

步骤 4:低风险验证

在授权明确的前提下,用单个公开 URL 执行一次测试,验证以下要点:

- HTTP 状态码为 200(注意:200 仅表示网络请求在协议层成功,并不代表内容有效——仍需确认返回内容不是登录页、验证中间页、错误提示页或空壳页面)

- 返回内容是目标中文文本,而非 HTML 空壳或 JS 占位符

- 字符编码正常,无乱码(出现乱码通常是 GBK/UTF-8 混淆;需检查响应头

Content-Type字段) - 未触发 403、429 或重定向至验证页

验证通过后,如果需要将抓取到的原始 HTML 内容转换为干净的 Markdown 供后续 AI 处理,可搭配 Markdown.new 技能 markdown-convert。需要注意:markdown-convert 的作用是抓取完成后的内容清理与格式转换,它不影响访问授权、页面渲染能力,也不具备访问稳定性验证功能——请勿将其用于处理访问受限或未完成渲染的页面。

常见失败点与合规降级路径

| 失败现象 | 可能原因 | 处理方向与合规降级路径 |

|---|---|---|

| 返回内容为空或 JS 占位符 | 目标页面需要 JavaScript 渲染 | 换用具备真实浏览器内核的 skill;确认该 skill 详情页有渲染能力说明 |

| 中文内容显示乱码 | 字符编码未正确处理(GBK vs UTF-8) | 检查响应头 Content-Type 字段,手动指定解码方式;如需简繁转换,在配置中声明 |

| 403 Forbidden | 请求被站点访问控制拦截 | 检查目标站点 robots.txt 与使用协议;如在授权范围内,可配置合规的 User-Agent 标识,或切换至隐身浏览器技能并在详情页确认适用条件 |

| Cloudflare 验证页卡住 | 自动化访问触发 Bot Management 检测 | 先确认授权与协议;在授权前提下,前往 stealth-browser 详情页核查适用条件声明,通过低风险验证(单 URL)确认后再继续;验证失败则停止或改用官方 API |

| 429 Too Many Requests | 请求频率超过站点限制 | 严格降低请求频率;授权多页批量场景可评估 fast-browser-use 的多标签管理能力(需在详情页确认速率控制说明) |

| CAPTCHA 出现 | 访问行为触发验证码机制 | 不应尝试自动化处理 CAPTCHA。可选择:(1)人工完成验证;(2)改用目标站点官方 API;(3)如自动化访问受到明确限制,停止并评估替代方案 |

| 会话过期导致重复登录 | Cookie 或 Session 未持久化 | 使用详情页明确提及持久会话管理的 skill,按详情页说明配置 Cookie 存储路径 |

| robots.txt 或使用协议禁止自动化访问 | 目标站点明确限制爬虫或自动化采集 | 停止自动化访问;改用目标站点官方 API、RSS 订阅或数据导出功能;如需数据请通过合规渠道申请 |

| 授权状态不明确 | 使用协议表述模糊,无法判断是否允许自动化访问 | 优先联系站点方确认;在授权明确前停止自动化访问;可先使用官方 API/RSS 替代 |

总结

适用人群

- 需要在授权范围内自动抓取中文网页内容的 Claude Code / OpenClaw 用户

- 正在评估哪个爬虫 skill 的详情页声明符合自己场景的用户

- 遇到访问限制问题、需要明确合规处理方向的用户

不适合场景

- 目标站点在 robots.txt 或使用协议中明确禁止自动化抓取

- 授权状态不明确或无法确认(应停止,而非假设允许)

- 目标站点提供官方 API/RSS/导出功能且满足需求(应优先使用官方途径)

- 需要实时数据流(建议优先考虑目标站点的官方 API)

下一步推荐路径

完成合规前置确认与前置条件核查后,按以下顺序推进:

- 轻量场景:从 浏览器使用 browser-use 开始,用单 URL 完成第一次低风险验证。

- 授权多页批量场景:在验证基本路径后,评估 极速浏览器使用 fast-browser-use 详情页中关于多标签与状态管理的能力声明;注意速率限制合规要求。

- 有访问限制的场景:前往 隐身浏览器 stealth-browser 详情页,仔细确认环境兼容性、适用条件声明和首次登录流程,通过单 URL 低风险验证后再继续;验证失败时停止或降级。

如需浏览更多浏览器自动化与爬虫类 skill,可前往 ClawSkills 技能库,在详情页说明中核查"浏览器与自动化"相关技能的适用条件。

常见问题

Q:在 ClawSkills 上安装爬虫 skill 需要哪些前置条件?

不同 skill 的前置条件不同,需在各技能详情页单独确认。通常需要:对应 CLI 工具已安装(如 browser-use CLI)、具备可运行浏览器的系统环境。ClawSkills App 安装入口仅在详情页提供该入口时可用;如详情页未提供,应按手动配置说明操作,不预设一键安装可用。

Q:隐身浏览器 stealth-browser 能处理所有访问限制场景吗?

不能。该 skill 的详情页说明覆盖了部分 Cloudflare、持久会话等场景,但任何访问稳定性技术的有效性都受目标站点策略更新影响。使用前应在详情页确认当前适用条件,并通过低风险验证(单 URL 测试)确认实际效果。验证失败时应停止或降级,而非反复尝试。

Q:中文网站爬取时出现乱码怎么处理?

优先检查响应头中的 Content-Type 字段,确认字符编码声明(UTF-8 或 GBK)。部分旧式中文站点默认 GBK 编码,若 skill 自动以 UTF-8 解码则会出现乱码,需在配置中显式指定解码方式。如输出需要简繁转换或全角/半角标准化,也应在配置阶段声明。

Q:browser-use 和 fast-browser-use 如何选择?

browser-use 适合通用场景和初次低风险验证;fast-browser-use 的详情页声明支持授权多页批量抓取、多标签管理和精确 DOM 提取,适合任务量较大或需要精细状态控制的场景。建议先用 browser-use 验证基本路径,按需再切换——切换前需重新核查详情页中的适用条件与速率限制说明。

Q:skill 配置完成后,如何确认爬取成功?

需验证以下四个指标:(1)HTTP 状态码为 200(仅表示网络请求在协议层成功,不代表内容有效);(2)返回内容不是登录页、验证中间页、错误提示页或空壳页面;(3)返回内容包含目标中文文本;(4)字符显示正常无乱码。四项均通过视为基本验证成功,再扩大到多个 URL 进行稳定性确认。